Esta es la noticia

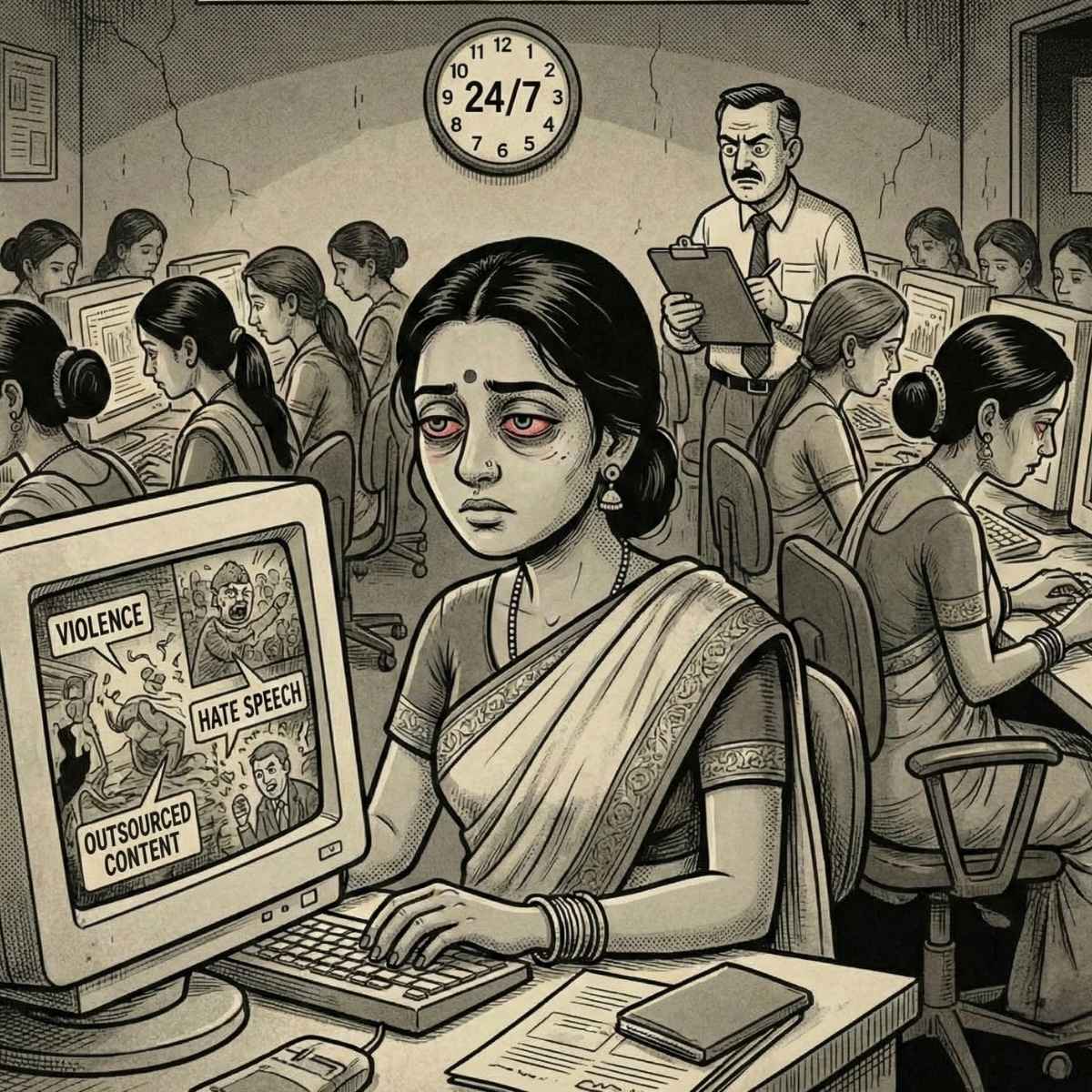

El 5 de febrero de 2026, el diario británico The Guardian publicó un reportaje demoledor sobre mujeres en India dedicadas a la moderación de contenido y al etiquetado de datos para grandes tecnológicas occidentales. Revisan cada día imágenes y vídeos que los algoritmos ya han marcado como potencialmente violentos o sexuales: violaciones, abusos infantiles, suicidios en directo, gore extremo. El artículo recoge testimonios de insomnio crónico, ansiedad, embotamiento emocional y un vacío que una de ellas resume así: "al final, te sientes en blanco". Todo a través de empresas intermediarias, contratos temporales y acuerdos de confidencialidad.

Lo que mi cabeza me dice

Existe una fantasía cómoda que conviene desmontar de una vez: la inteligencia artificial aprende sola. Se entrena con datos, detecta patrones y evoluciona con una inevitabilidad casi biológica. El relato es precioso porque elimina cualquier fricción moral. Si algo es "natural", nadie es responsable.

Pero la IA no aprende sola. Aprende mirando. Y antes de que el algoritmo mire, alguien tuvo que mirar primero.

Para que un modelo detecte violencia sexual en milisegundos, una mujer en un pueblo de Jharkhand tuvo que ver la violación completa. Antes de que el sistema bloquee pornografía extrema, alguien la consumió entera para clasificarla. Antes de que el modelo aprenda qué es abuso infantil, otra persona lo tuvo delante durante horas, días, semanas.

La automatización no elimina el trabajo humano. Lo desplaza hacia el sótano. Y como todo sistema optimizado por costes, asigna la carga donde resulta más barata: mujeres en zonas rurales, con poca movilidad laboral y aún menos capacidad de negociación. No porque haya un algoritmo misógino. Simplemente porque el mercado segmenta con precisión quirúrgica.

El trabajo remoto permite ingresos sin migrar. En contextos donde salir de casa sigue siendo un acto condicionado por normas sociales rígidas, eso se vende como "oportunidad". Y como tantas veces en la historia industrial, las tareas repetitivas, invisibles y emocionalmente tóxicas se feminizan. Nada revolucionario. Es economía del trabajo aplicada a la era digital.

Lo retorcido es otra cosa. Estas trabajadoras limpian el internet de los mismos países que lideran la industria de la IA que, en breve, promete automatizar su propio puesto. Primero absorben el trauma necesario para entrenar el sistema. Después, el sistema se presenta como solución eficiente que reduce la necesidad de intervención humana. Es un círculo elegante: externalizas el daño, internalizas el beneficio.

El sistema funciona porque el silencio funciona. Se presenta como una misión noble —"hacemos internet más seguro"— y, en parte, lo es. Sin esa mano de obra invisible, la red sería un vertedero. Pero también es cierto que el modelo depende de que alguien absorba el impacto emocional para que el producto final parezca limpio, automático y aséptico.

El algoritmo no tiene pesadillas. La GPU no sufre estrés postraumático secundario. El modelo no se despierta a las tres de la mañana con imágenes que no puede borrar. Alguien más lo hace.

Y mientras eso ocurre en el sótano operativo de la inteligencia artificial, en la planta noble de San Francisco el debate es otro. En 2025, OpenAI anunció el desarrollo de un "modo adulto" para ChatGPT: interacciones eróticas con verificación de edad. La decisión generó tensiones internas y la salida de una ejecutiva que expresó reservas sobre esa dirección estratégica.

La ironía no necesita exageración. Abajo, mujeres revisan violaciones reales para entrenar filtros. Arriba, se estudia cómo monetizar simulaciones eróticas con seguridad y escalabilidad. Lo que para unas es coste operativo invisible, para otros es línea de crecimiento.

La próxima vez que pienses que ChatGPT es mágicamente limpio, recuerda que la magia no existe. Existe trabajo que no ves y trauma que no contabilizas.

Lo que los datos dicen

- Riesgo psicológico documentado. Estudios académicos recientes sobre moderación de contenido identifican estrés traumático secundario, ansiedad persistente, insomnio y embotamiento emocional como efectos frecuentes en trabajadores expuestos de forma continuada a material violento o sexual explícito. Fuente: investigaciones académicas y cobertura periodística especializada (2023–2026).

- Modelo de entrenamiento. Los sistemas de IA requieren grandes volúmenes de datos etiquetados manualmente para su entrenamiento y ajuste fino; la moderación automática opera bajo esquemas "human-in-the-loop" que combinan filtros algorítmicos con revisión humana sistemática. Fuente: literatura técnica sobre machine learning y sistemas de moderación.

- Estructura contractual. La moderación y el etiquetado de datos se realizan habitualmente mediante empresas intermediarias, con contratos temporales, salarios ajustados y acuerdos de confidencialidad estrictos que limitan la visibilidad pública del trabajo. Fuente: investigaciones sobre cadenas globales de trabajo digital (2024–2026).

- Evolución de producto. En 2025–2026, OpenAI comunicó avances en funcionalidades orientadas a interacciones eróticas con verificación de edad en ChatGPT, en un contexto de debate interno sobre límites éticos y regulatorios. Fuente: comunicaciones públicas de la compañía y cobertura mediática.